Esta semana se realizó la primera clase del curso MDSC3S132-1 Deep Learning, dictado en el Magíster en Data Science. La asignatura está orientada a profesionales que ya trabajan con datos, análisis o machine learning y buscan profundizar en el funcionamiento y la implementación de redes neuronales modernas.

La sesión inicial estuvo enfocada en establecer las bases conceptuales del deep learning, procurando que cada idea pudiera conectarse rápidamente con su implementación práctica. Más que centrarse exclusivamente en el desarrollo matemático, el objetivo fue comprender la intuición detrás del entrenamiento de redes neuronales y cómo estas estructuras permiten modelar patrones complejos en los datos.

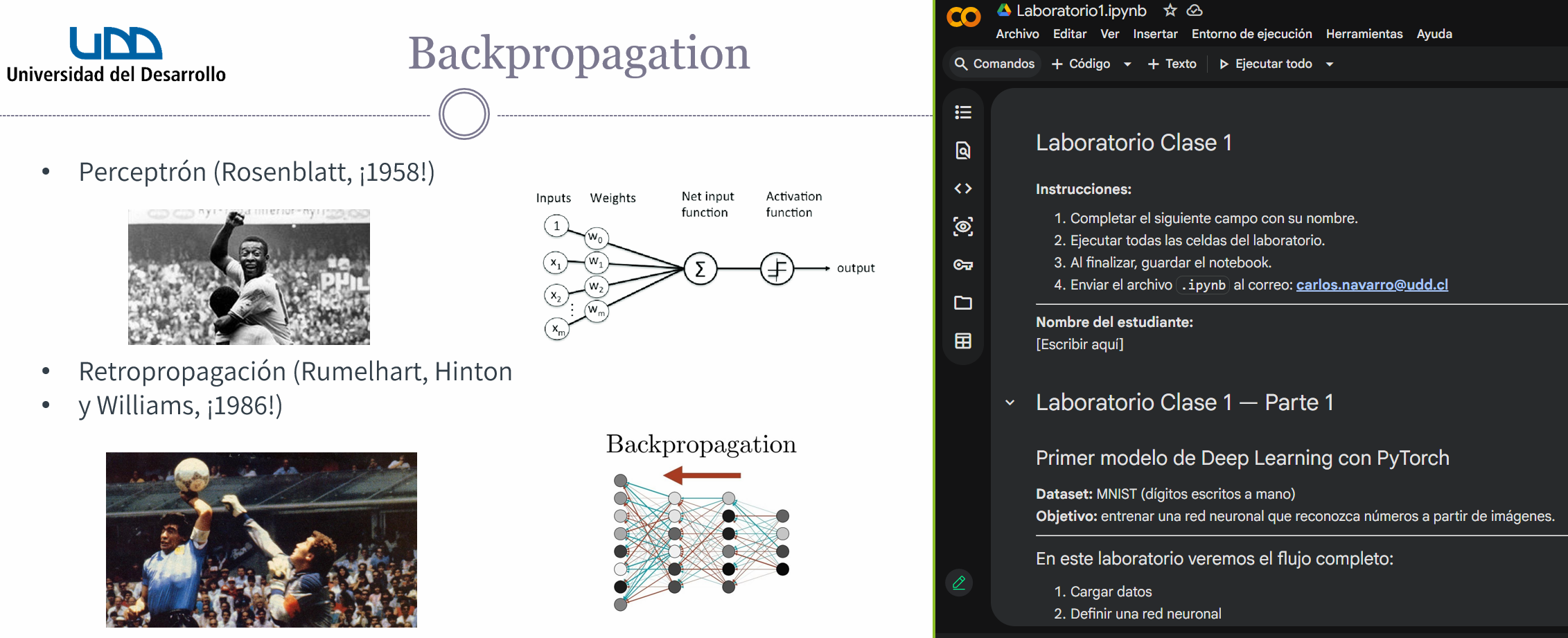

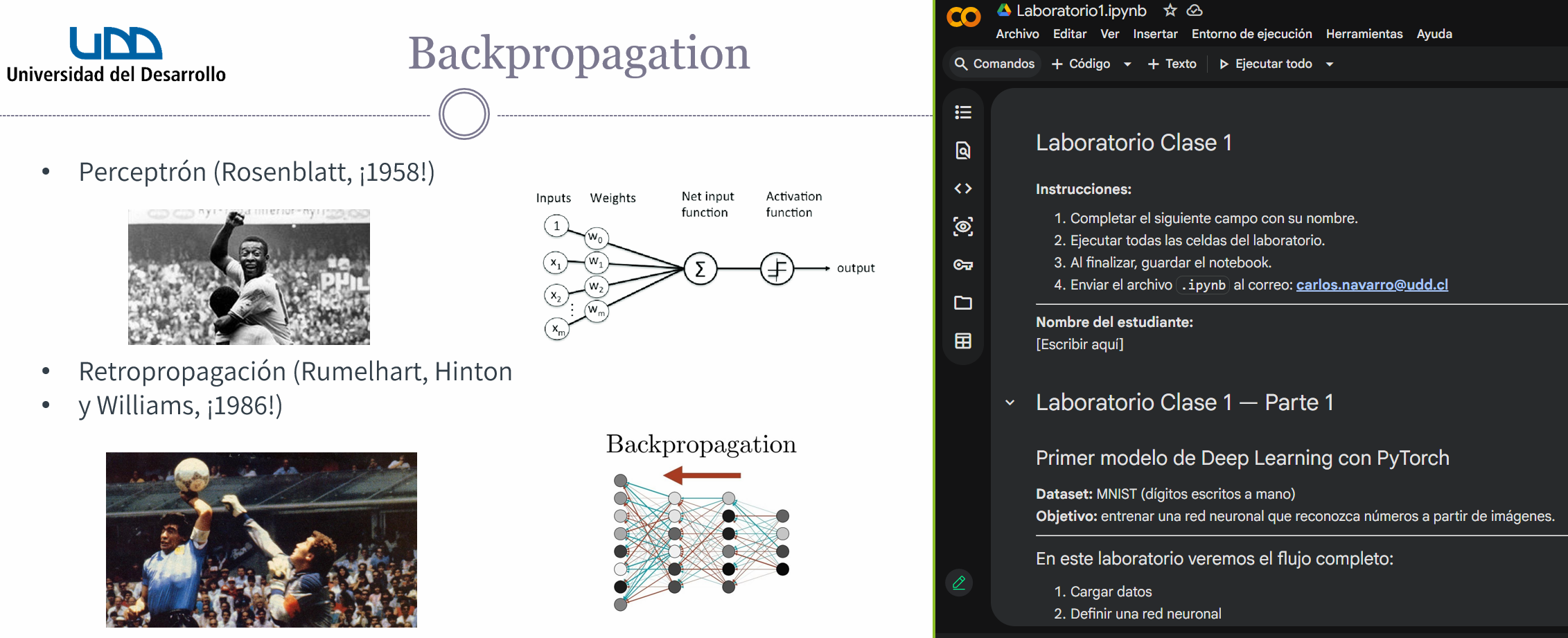

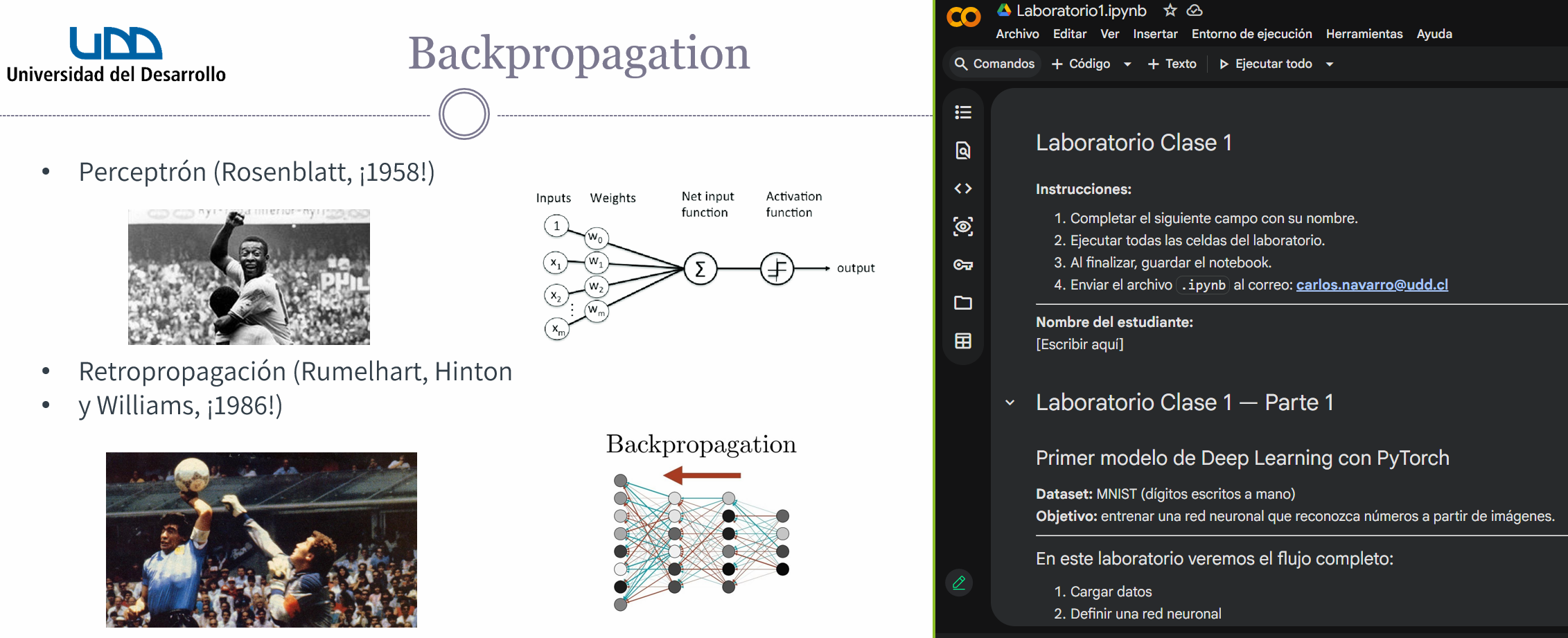

Durante la clase se revisaron distintos conceptos fundamentales, entre ellos la evolución desde el machine learning clásico hacia los enfoques actuales de deep learning, la estructura y funcionamiento de una red neuronal artificial, el rol del perceptrón multicapa (MLP), la importancia de las funciones de activación y la intuición detrás del algoritmo de backpropagation, mecanismo que permite ajustar los parámetros del modelo durante el proceso de entrenamiento.

Figura 1: Diapositiva de la clase dedicada a backpropagation y vista inicial del laboratorio en PyTorch desarrollado durante la primera sesión del curso.

Tras la introducción conceptual, la segunda parte de la sesión consistió en un laboratorio práctico utilizando PyTorch, uno de los frameworks más utilizados actualmente para el desarrollo de modelos de deep learning. El ejercicio permitió recorrer el flujo completo de construcción de un modelo: desde la carga de datos, la definición de la arquitectura de la red neuronal, el proceso de entrenamiento y la posterior evaluación del desempeño del modelo.

Para este primer ejercicio se utilizó el dataset MNIST, un clásico conjunto de datos compuesto por imágenes de dígitos escritos a mano, ampliamente utilizado para introducir los conceptos básicos de clasificación en deep learning. Posteriormente, se repitió el mismo flujo de trabajo utilizando Fashion-MNIST, un dataset de imágenes de productos de vestuario como camisetas, zapatillas y bolsos, lo que permitió acercar el ejemplo a escenarios más cercanos a aplicaciones reales como la clasificación automática de catálogos en comercio electrónico.

Durante el laboratorio, los estudiantes también experimentaron modificando algunos hiperparámetros básicos del modelo, tales como el tamaño de la capa oculta, el learning rate y la función de activación. Estos ajustes permitieron observar cómo pequeñas decisiones de diseño pueden influir significativamente en la dinámica de entrenamiento y en el desempeño final de una red neuronal.

En las próximas sesiones el curso abordará temas más avanzados desde una perspectiva aplicada, incluyendo optimización y regularización de redes profundas, redes convolucionales (CNN) para problemas de visión computacional, modelos secuenciales como RNN, LSTM y GRU, así como una introducción a modelos generativos. La propuesta del curso es combinar permanentemente intuición conceptual e implementación práctica, de modo que cada clase incorpore laboratorios breves donde los estudiantes puedan experimentar directamente con los modelos.